Проблема узнаваема: вчера всё летало, сегодня клиенты жалуются на виснущую корзину, а отдел маркетинга требует залить больше трафика. Сервер «еще тянет», но htop постоянно красный. Вы перестали успевать обрабатывать запросы, страх парализует команду, а каждая акция грозит коллапсом.

Менять сервер на вдвое более мощный не лечение, это покупка костыля для пациента с переломом позвоночника. Большинство проблем производительности лежат в логике приложения и архитектуре данных именно поэтому, в первую очередь необходимо внедрение Битрикс24 и автоматизация бизнеса, а не покупка мощных серверов. Ниже - реальные кейсы и примеры ошибок, с которыми я сталкивался, и жесткие рецепты их исправления.

Архитектурный аудит: почему 1000 пользователей убивают базу данных

Когда нагрузка растет, стандартная LAMP-подобная конструкция начинает рассыпаться. Проблема не в количестве людей, а в том, как написаны запросы. У классического сценария (PHP/Python/Node + MySQL/PostgreSQL) есть подлый нюанс: база данных становится «горлом» (bottleneck).

- Пример фатальной ошибки: В коде интернет-магазина на популярной CMS был цикл, который для вывода списка из 100 товаров делал 1 запрос на получение ID и еще 100 запросов (N+1) для получения остатков и картинок. При 50 пользователях БД держалась, при 200 - падала с ошибкой «Too many connections».

- Диагностика: Включите медленный лог SQL (slow query log) на 1 секунду. Вы будете в шоке от количества повторяющихся легковесных запросов. Ищите места, где нет join или eager loading.

- Решение: Рефакторинг ORM-запросов. Запретите выбирать данные в циклах. Используйте пакетную загрузку. Если у вас 100 товаров, за один раз запросите все 100 записей из таблицы

product_imagesчерезWHERE product_id IN (1,2,3...100). Сокращение числа запросов с 101 до 3 даст прирост скорости в 10 раз без апгрейда сервера.

Кэш убивает продажи: как не врать клиенту про остатки

Кэширование - палка о двух концах. Страница, сгенерированная раз в минуту, спасает CPU, но убивает доверие. Самая частая боль: вы кэшируете главную и каталог, чтобы держать удар, но в это время на склад поступил дефицитный товар или, наоборот, последняя единица ушла в офлайн-магазине.

Пример фатальной ошибки: Во время «Черной пятницы» магазин смартфонов настроил Cache-Control: max-age=3600 для карточек товаров. Спецпредложение на iPhone кончилось за 15 минут, но сайт еще час показывал «В наличии» и кнопку «Купить». Пользователи оформляли заказы, получали отмены через 30 минут (ручная проверка менеджером). Репутация и карта лояльности - в мусор. Фиаско.

Как делать технически грамотно: Используйте гибридные стратегии. Для публичного каталога - CDN с stale-while-revalidate. Пример заголовка для карточки: Cache-Control: s-maxage=60, stale-while-revalidate=86400. Что это дает: 60 секунд данные живут в кэше CDN. Далее, до 24 часов, CDN отдает старую версию (мгновенно), но одновременно фоново обновляет данные из БД. Пользователь не ждет, а данные обновляются в фоне.

Нюанс: Никогда не кэшируйте корзину и личный кабинет. Для авторизованных пользователей заголовки кэширования должны быть private или no-cache.

Тяжелые фильтры: почему поиск работает как улитка

Поиск и фильтрация по характеристикам ад для SQL. Обычные индексы здесь спасают слабо, когда у товара 50 динамических свойств и идет выборка по 10 из них одновременно.

Пример фатальной ошибки: Онлайн-магазин автозапчастей с каталогом в 500к SKU. Фильтр по машине (марка->модель->год->двигатель) в базе данных MySQL выполнялся через 5 вложенных подзапросов к таблице свойств EAV (Entity-Attribute-Value). Запрос шел 8 секунд. Сервер ложился при 50 запросах в секунду.

Решение: Убить запросы к БД для этой задачи. Нужно выгрузить данные в поисковый движок. Технический стек:

- Elasticsearch или Apache Solr. Это NoSQL-решения, инвертированные индексы которых созданы для фильтрации.

- Как работает: При сохранении товара (событие

product.update) вы отправляете плоский массив «id=123, name=Деталь, vendor=BMW, price=100, attribute_engine=2.0» в Elasticsearch. - Результат: Фильтрация по 10 полям происходит за 0.0035 секунды вместо 0.5 секунд.

При этом снимите нагрузку с основной базы. PostgreSQL/MySQL должны заниматься только транзакциями (оформление заказа, списание остатков), а не аналитикой и поиском.

Гонка запросов и блокировка таблиц (Deadlock)

Страх и паника наступают, когда при одновременном оформлении заказа на товар, которого осталось 2 штуки, 100 человек нажимают «Купить». В этот момент база данных начинает блокировать таблицу products, чтобы обновить остаток. Возникает Deadlock - взаимная блокировка транзакций. Сервис становится.

Пример фатальной ошибки: Обновление остатка через UPDATE products SET stock=stock-1 WHERE id=X в транзакции по умолчанию. При 200 RPS транзакции начинают вставать в очередь.

Техническое решение: Используйте атомарные запросы без лишних выделенных транзакций там, где это возможно. Если нужно забронировать товар:

- Пытаемся выполнить

UPDATEс условиемWHERE stock > 0. - Смотрим на количество затронутых строк (affected rows).

- Если

affected_rows == 0, значит товар кончился. Завершаем заказ.

Избегайте SELECT FOR UPDATE без острой необходимости. Для подсчета популярных товаров используйте очереди (RabbitMQ, Redis Streams), а не запись в базу при каждом просмотре. Кешируйте счетчики просмотров и обновляйте их раз в 5 минут.

Проблема 1% данных или «Горячая строка»

Иногда тормоза возникают не из-за объема таблицы, а из-за частоты обращения к конкретной записи. Например, у вас есть «Товар дня» со скидкой 90%. На него идет 40% всего трафика. Эта строка в БД постоянно обновляется (кто-то смотрит, кто-то покупает).

Пример фатальной ошибки: В пик нагрузки блокировки этой одной строки убивают производительность всей таблицы products.

Решение: Вынесите «горячие» данные в Redis (In-Memory хранилище). Цена, остаток и популярность хита должны жить в оперативной памяти, а не на диске. Redis обрабатывает десятки тысяч операций в секунду на одном ядре. Синхронизацию с основной БД (MySQL/PostgreSQL) делайте асинхронно через задачу в очереди. Пользователь видит скорость света, а база не блокируется.

Как тренировать команду и бороться со страхом (DevOps практики)

Страх парализует. Бояться релиза в пятницу вечером из-за того, что «вдруг упадет», нормально, если у вас нет мониторинга.

Что внедрить за выходные:

- Feature flags (Тогглы). Никогда не выкатывайте новый тяжелый модуль прямо в прод. Спрячьте его за флагом. Включили, нагрузили 1% трафика, посмотрели на графики. Ошибка - отключили за 5 секунд.

- Graceful degradation. Если поисковый движок Elasticsearch упал, сайт не должен падать полностью. В коде должна быть логика: «Не работает Solr? Ищем по SQL в 10 раз медленнее, но сайт работает». Пользователь лучше подождет 3 секунды, чем увидит 502-ю ошибку.

- Автомасштабирование (K8s HPA). Не нанимайте сисадмина, который будет ночью вручную поднимать сервера. Настройте горизонтальное масштабирование подов в Kubernetes по метрике CPU/RPS.

Сложности кэширования динамики (Персонализация)

В 2025 году персонализация - стандарт. Показывать одинаковую цену и блоки «рекомендуем» всем - архаизм. Но персонализация убивает CDN, потому что для каждого пользователя страница уникальна (Cookie: session_id=...).

Пример фатальной ошибки: Включили рендеринг на сервере (SSR) с персонализированными блоками. Сервер перестал справляться, так как не мог кэшировать страницы из-за разных кук.

Техническое решение: Edge Side Includes (ESI) или архитектура Partial Caching. Мы кэшируем на CDN 99% страницы товара (описание, фото, характеристики) на 1 час. А блок «Ваша цена» или «Остаток на вашем складе» подгружаем отдельным асинхронным AJAX-запросом с клиента или через асинхронный фрагмент на уровне Reverse-Proxy (Nginx). Так и скорость высокая, и данные персональные.

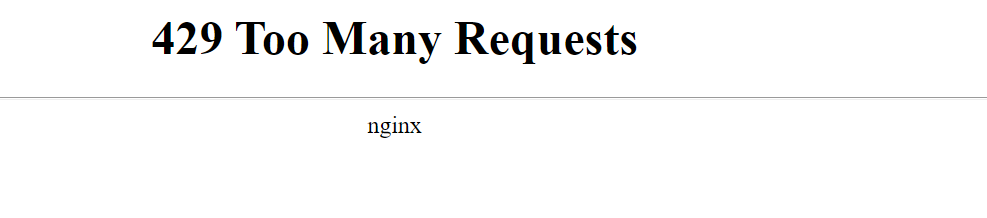

Готовимся к неизбежному

Раз уж вы перестали успевать, значит, план «Б» нужен здесь и сейчас. Внедрите Rate Limiting (Лимитирование запросов). Если бот или один агрессивный пользователь долбит ваш API с частотой 1000 запросов в секунду, роутер (Nginx/Kong) должен отдавать ему 429 Too Many Requests, не дергая бэкенд.

Используйте Circuit Breaker (Предохранитель) для внешних сервисов. Если ваш партнер по доставке или платежный шлюз начинает тормозить (таймаут 5 секунд), «выбивает пробку» - код перестает ждать ответа от этого сервиса и возвращает заглушку или кэшированный ответ. Это не дает одному медленном сервису завалить весь магазин.

Сравнительная таблица подходов к повышению производительности

Ниже приведена сводка методов и их эффективности при разных типах нагрузок. Данные основаны на реальной эксплуатации.

| Метод | Снижение времени ответа | Рост пропускной способности | Сложность внедрения | Риск ошибок данных | Когда применять |

|---|---|---|---|---|---|

| Устранение N+1 запросов | 70-90% | 300-500% | Низкая | Низкий | Всегда при цикличных запросах |

| CDN с stale-while-revalidate | 60-80% | 1000% | Средняя | Средний | Каталог, блоги, статика |

| Elasticsearch вместо SQL фильтров | 80-95% | 500-1000% | Высокая | Низкий | Поиск, динамические фильтры |

| Redis для горячих строк | 50-70% | 200-400% | Средняя | Низкий | Товар дня, лидеры продаж |

| Очереди RabbitMQ | не влияет | 200-300% | Высокая | Низкий | Бронирование, уведомления |

Не ищите волшебную кнопку «ускорить». Идите по цепочке: кэш браузера -> CDN (с stale) -> Redis (кеш данных) -> Elasticsearch (поиск) -> очередь (бронирование) -> основная БД (ядро). Убрав лишние сущности и настроив индексы, вы понимете, что проблемы были не в железе, а в голове архитектора. Дерзайте, пока конкурент не перехватил ваших уходящих клиентов.